Seguindo o exemplo do Instagram para impedir que os usuários postem comentários ofensivos, o YouTube também decidiu avisar os usuários quando seus comentários podem ser ofensivos para outros na tentativa de tornar a plataforma um lugar melhor para interações saudáveis.

Avise os usuários que postam comentários de ódio

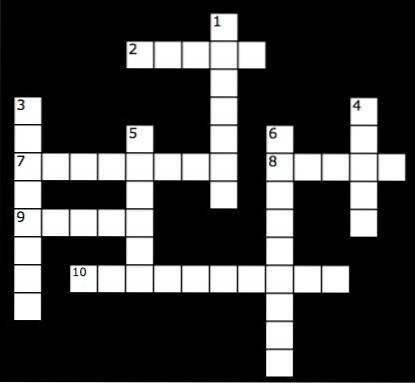

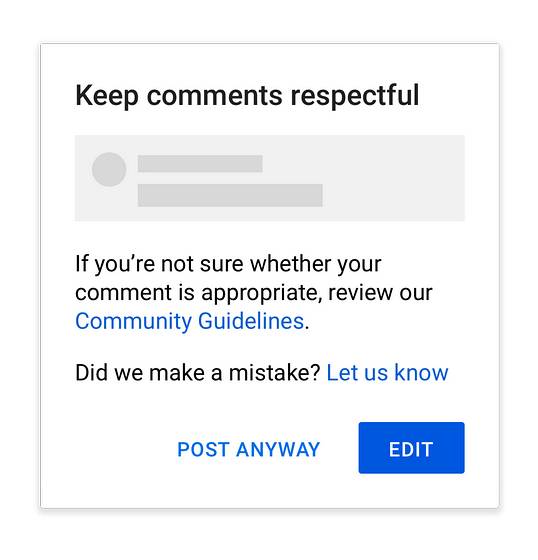

Os usuários que postam comentários de incitação ao ódio verão um banner pop-up para lembrá-los se realmente desejam fazê-lo. Os comentadores podem então escolher editar o comentário original ou postar o comentário em seu estado atual. Esses avisos aparecerão primeiro no YouTube para Android. E é assim que vai ficar:

Como esse é um recurso automatizado, é possível que os sistemas do YouTube sinalizem acidentalmente seu comentário como ofensivo. Nesses casos, quando você achar que o sistema cometeu um erro, toque no link "Informe-nos" no pop-up para deixar comentários.

Da mesma forma, mesmo que o YouTube AI não sinalize seu comentário como ofensivo, ele ainda pode ser retirado se violar as diretrizes da comunidade da empresa. Além do comentador, o proprietário do canal tem controles para remover comentários potencialmente ofensivos.

Em um FAQ em sua página de suporte, o Google esclarece como considera um comentário impróprio. “Nosso sistema aprende com o conteúdo relatado repetidamente pelos usuários. Esperamos aprender mais sobre quais comentários podem ser considerados ofensivos à medida que continuamos a desenvolvê-lo ”, diz o Google.

Outros novos recursos do YouTube

Além de avisos de comentários, o YouTube também é testando um novo recurso do YouTube Studio para filtrar comentários inadequados e prejudiciais que estão com revisão pendente. Dessa forma, o YouTube diz que os criadores não terão que passar por comentários ofensivos se não quiserem.

O YouTube também está trabalhando para identificar qualquer tendência não intencional em seus sistemas em termos de monetização. Para isso, a empresa pedirá aos criadores que revelem voluntariamente seu gênero, orientação sexual, raça e etnia em 2021.

Gadgetshowto

Gadgetshowto